하네스 엔지니어링: 왜 이제는 모델보다 작업 환경 설계가 성능을 좌우하나

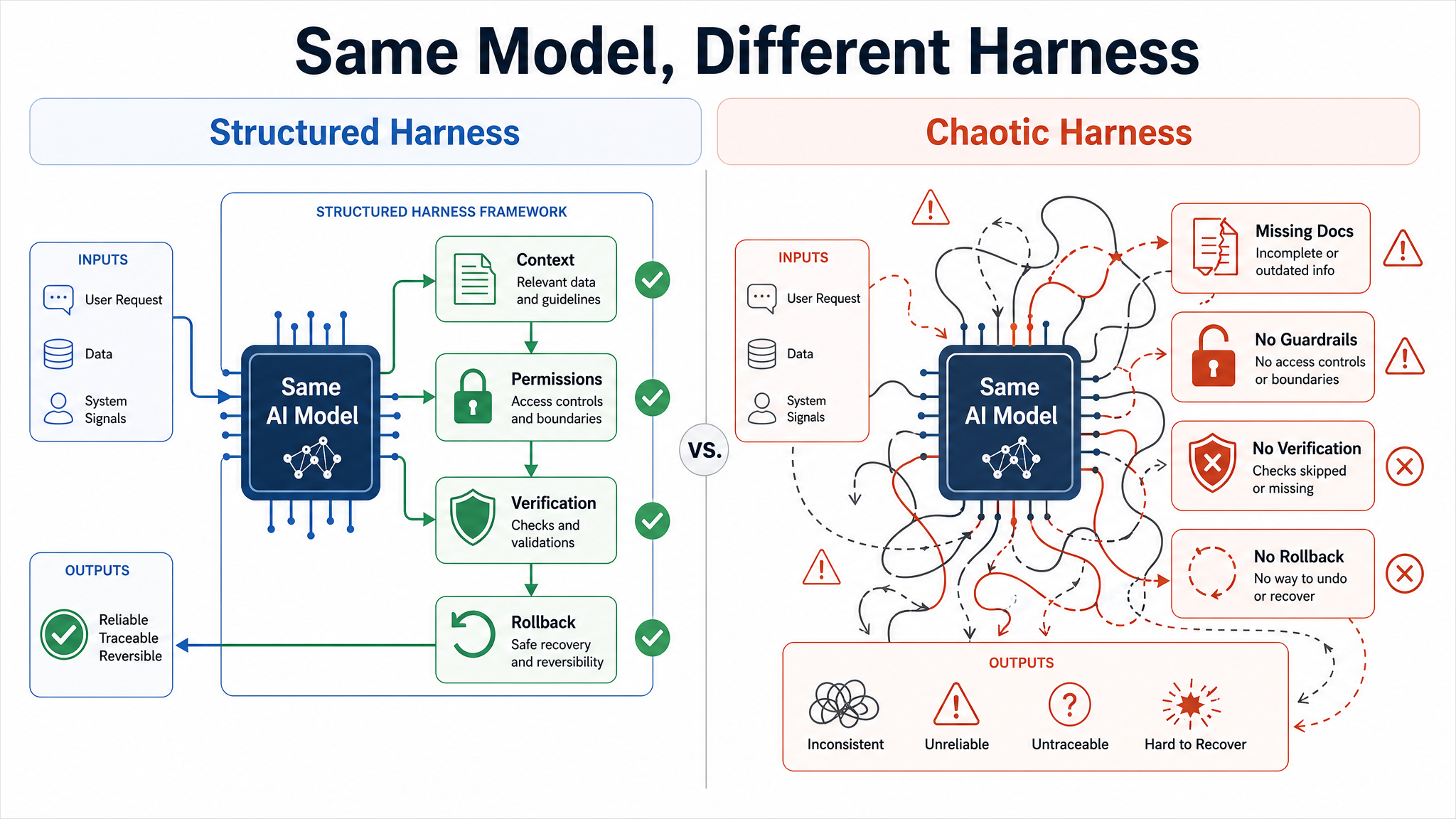

이제 에이전트 성능 차이는 모델 스펙보다 작업 환경에서 더 크게 난다. 같은 모델을 붙여도 어떤 팀은 실무에 바로 얹고, 어떤 팀은 데모만 번쩍하다가 운영에서 터진다. 그 차이를 만드는 건 대부분 모델의 지능이 아니라, 에이전트가 일하도록 만들어둔 하네스다.

배포는 끝났는데 누가 쓰는지 모르고, 코드 소유권도 애매하고, 에이전트가 어디까지 만졌는지도 불분명하다면 그건 아직 제품이 아니라 데모에 가깝다. 바이브 코딩이 시작 속도를 올려준 건 맞지만, 그 다음 승부는 계측·소유권·검증·복구가 닫힌 운영 레이어에서 난다.

요즘 한국 커뮤니티에서는 DESIGN.md나 작업환경 설계 이야기가 눈에 띄게 올라오고 있고, 글로벌 쪽에서는 agent eval, 프로덕션 테스트, trust filter 얘기가 동시에 커지고 있다. 겉으로는 다른 얘기처럼 보여도 결론은 하나다. 이제 차이는 모델보다 작업 시스템에서 난다.

그리고 이 작업 시스템도 점점 더 구체적인 언어로 내려오고 있다. 최근 신호를 묶어보면 핵심은 네 가지다. typed memory, distributed sentinel, grounding recovery, precision routing. 즉 이제 에이전트 경쟁은 단순 모델 성능보다 무엇을 기억하게 할지, 누가 위반을 감시할지, 틀렸을 때 어떻게 복구할지, 어디에만 높은 정밀도를 쓸지 설계하는 쪽으로 이동하고 있다.

운영 레이어라는 말에 계측과 소유권이 빠지면 다시 데모가 된다

하네스 이야기를 하면 많은 팀이 바로 프롬프트 구조나 권한 분리부터 떠올린다. 물론 중요하다. 그런데 실제 운영에서 더 빨리 문제를 터뜨리는 건 의외로 단순한 질문들이다.

- 지금 이 자동화가 실제로 얼마나 쓰이고 있는가

- 이 결과물의 최종 소유자는 사람인가, 에이전트인가, 아니면 아무도 아닌가

- 실패했을 때 누가 책임지고 어디서 멈출 것인가

- 다음 실행에서 같은 실수를 다시 막을 장치가 있는가

이 질문에 답이 없으면, 하네스는 있어 보여도 운영 레이어는 비어 있다. 그래서 나는 이제 에이전트 경쟁을 모델 경쟁보다 measurement + ownership + harness 경쟁으로 보는 쪽이 더 정확하다고 느낀다. 같은 모델을 써도 어떤 팀은 반복 가능한 시스템을 만들고, 어떤 팀은 며칠 뒤 로그도 못 읽는 데모 더미만 남긴다.

모델 비교표가 설명하지 못하는 성능 차이

몇 달 전까지만 해도 질문은 단순했다. Claude가 낫냐, GPT가 낫냐, Gemini가 낫냐. 그 비교는 아직도 의미가 있지만, 실무에서는 점점 덜 중요해지고 있다.

왜냐하면 같은 모델도 올려두는 환경이 다르면 결과가 완전히 달라지기 때문이다.

- 어떤 팀은 에이전트에게 필요한 문맥을 미리 정리해준다.

- 어떤 팀은 권한 경계를 세분화해 실수의 반경을 줄인다.

- 어떤 팀은 중간 산출물을 검증하고, 잘못되면 바로 rollback 한다.

- 어떤 팀은 그냥 “잘 해봐” 하고 빈 터미널만 던진다.

마지막 경우에도 데모는 잘 나온다. 문제는 운영이다. 에이전트가 한 번 엇나갔을 때 어디서 멈춰야 하는지, 무엇을 믿지 말아야 하는지, 누가 마지막 책임을 지는지 정해져 있지 않으면 성능은 금방 환상으로 바뀐다.

나는 이걸 이제 모델 경쟁의 다음 단계라고 본다. 첫 번째 라운드가 “누가 더 똑똑한가”였다면, 지금 라운드는 “누가 더 안전하고 재현 가능하게 일하게 만들었는가”다.

DESIGN.md가 코드보다 먼저 경쟁력이 되는 순간

DESIGN.md가 괜히 뜨는 게 아니다. 에이전트에게 가장 비싼 자원은 토큰이 아니라 의도 파악 비용일 때가 많기 때문이다.

사람끼리 일할 때도 마찬가지다. 설계 의도가 문서로 남아 있으면 인수인계가 빨라지고, 수정 방향이 흔들리지 않는다. 에이전트는 여기서 한 단계 더 극단적이다. 문서가 없으면 매번 다시 추론해야 하고, 그때그때 가장 그럴듯한 방향으로 흘러간다. 이게 반복되면 속도보다 편차가 먼저 커진다.

그래서 좋은 DESIGN.md는 단순한 문서가 아니라 작업 인터페이스에 가깝다.

예를 들어 이런 것들이 들어가야 한다.

- 이 작업의 목표는 무엇인가

- 절대 건드리면 안 되는 범위는 어디인가

- 성공 판정은 무엇인가

- 실패하면 어디까지 되돌릴 것인가

- 사람이 마지막에 반드시 확인해야 하는 항목은 무엇인가

이걸 미리 써두면 에이전트는 덜 똑똑해도 더 쓸 만해진다. 반대로 이걸 비워두면, 가장 좋은 모델을 써도 운영에서는 불안정해진다.

좋은 하네스는 보통 다섯 가지를 갖고 있다

결국 하네스 엔지니어링은 추상적인 철학이 아니라, 반복 가능한 작업 환경을 설계하는 일이다. 내가 지금 기준으로 보는 핵심은 다섯 가지다. 여기에 오늘 기준으로는 typed memory, trust filter, distributed sentinel, grounding recovery, precision routing 같은 운영 체크리스트 언어가 같이 붙기 시작했다.

1. 컨텍스트

에이전트가 무엇을 알고 시작하는지 정리돼 있어야 한다. PRD든, DESIGN.md든, 최근 결정 로그든, 최소한의 시작 문맥이 있어야 편차가 줄어든다. 여기서 한 단계 더 가면 긴 문맥을 무작정 밀어 넣는 대신 typed memory + version 규칙으로 기억 충돌을 다루는 설계가 중요해진다.

2. 권한 경계

읽기, 쓰기, 배포, 삭제 권한을 한 덩어리로 주면 언젠가 사고가 난다. 좋은 하네스는 능력을 키우는 것보다 먼저 실수 반경을 줄인다.

3. 툴 선택

에이전트가 어떤 도구를 언제 쓰게 할지 설계돼 있어야 한다. 검색, 테스트, 브라우저, 배포 도구를 무작정 다 열어주는 건 성능 향상이 아니라 노이즈 확대일 때가 많다.

4. 검증 루프

중간 산출물을 누가 어떻게 확인할지 빠져 있으면, 그럴듯한 오답이 계속 누적된다. 여기서 eval, tool-step verification, trust filter가 들어온다. 멀티에이전트로 가면 여기에 distributed sentinel과 grounding recovery까지 붙어야, 각 agent가 로컬로는 멀쩡해 보여도 전체 정책을 깨는 상황을 막을 수 있다.

5. 복구 설계

실패는 막을 수 없어도 복구 경로는 설계할 수 있다. checkpoint, rollback, dry-run, human gate가 있으면 운영 리스크는 급격히 줄어든다. 여기에 task마다 정밀도를 다르게 거는 precision routing까지 들어오면 비용과 지연도 함께 다룰 수 있다.

이 다섯 가지를 갖춘 팀은 모델이 조금 덜 좋아도 운영에서 버틴다. 반대로 이게 없으면, 벤치마크 점수가 높아도 실제 팀 생산성은 오래 못 간다.

프로덕션에서 진짜 중요한 질문은 “무엇을 믿지 말아야 하나”다

글로벌 쪽에서 agent eval과 trust filter 얘기가 커지는 이유도 여기 있다. 현장에서는 이미 알고 있다. 문제는 에이전트가 가끔 틀린다는 사실 자체가 아니라, 틀린 출력을 아무 장치 없이 운영에 통과시키는 구조다.

그래서 나는 에이전트 도입 논의가 “무엇을 자동화할까”에서 멈추면 부족하다고 본다. 거기서 한 번 더 가야 한다.

- 어떤 출력은 바로 실행해도 되는가

- 어떤 출력은 사람 검토를 거쳐야 하는가

- 어떤 액션은 sandbox 안에서만 허용해야 하는가

- 어떤 실패는 자동 복구 가능하고, 어떤 실패는 사람 호출이 필요한가

이 질문이 먼저 정리되면 에이전트는 도구가 된다. 이 질문이 빠져 있으면 에이전트는 언제 터질지 모르는 데모가 된다.

이 지점에서 블로그와 YouTube에서 각각 다른 이야기를 할 수 있다. 블로그는 왜 하네스와 작업환경 설계가 중요해졌는지를 설명하고, 영상은 eval과 trust filter가 없으면 실제로 어떻게 망가지는지를 더 직관적으로 보여줄 수 있다.

결국 다음 경쟁력은 하네스 자체를 패키징할 수 있느냐에 달려 있다

여기서 한 단계 더 가면 오늘 신호가 왜 운영 레이어로 모이는지도 설명된다. 이제 팀이 필요한 건 좋은 모델 접근권만이 아니다. 반복 가능한 템플릿, 재사용 가능한 workflow, 공유 가능한 검증 규칙을 묶어둘 수 있어야 한다.

글로벌에서 awesome-codex-skills, claude-code-templates, LibreChat, openclaw/openclaw 같은 흐름이 반응을 얻는 이유도 같다. 다들 모델 자체보다 그 위에 얹는 skill/workflow packaging을 만들고 있다. 한국에서 계측, 소유권, 하네스에 관심이 붙는 것도 결국 같은 문제의식이다. 여기에 최근 국내 피드가 배포 이후 사용성 측정으로 빠르게 이동하는 흐름까지 겹치면, 질문은 더 선명해진다. 이제 중요한 건 빨리 만들어 올리는 데서 끝나지 않고, 그 시스템이 실제로 어떻게 쓰였는지 측정하고 다시 개선 가능한가다. 빨리 만드는 건 이미 가능해졌고, 이제 차이는 어떤 운영 규칙을 패키지로 남기고 팀 자산으로 축적하느냐에서 난다.

좋은 하네스는 한 번 쓰고 사라지는 프롬프트가 아니다. 다음 작업자가 그대로 재사용할 수 있는 체크리스트, 권한 경계, 복구 규칙, 검증 템플릿으로 남아야 한다. 그렇게 돼야 생성이 운영으로 바뀌고, 개인 감각이 아니라 팀 자산이 된다.

이제 팀이 먼저 비교해야 할 건 모델이 아니라 작업 시스템이다

나는 앞으로 에이전트 도입 체크리스트의 첫 줄이 모델 이름이 아니어야 한다고 본다.

대신 이런 순서가 더 맞다.

- 이 작업에 필요한 문맥은 무엇인가

- 어디까지 자동화하고 어디서 멈출 것인가

- 어떤 검증 루프를 붙일 것인가

- 실패했을 때 어떻게 되돌릴 것인가

- 마지막 책임자는 누구인가

이걸 정리한 다음 모델을 고르면 된다. 순서를 바꾸면, 도입 초기에는 화려해 보여도 몇 주 뒤에 운영 피로가 먼저 온다.

만약 지금 팀에서 에이전트를 붙이고 있는데 성능 편차가 크거나, 데모는 잘 되는데 운영이 불안하다면 모델 비교표보다 먼저 하네스 체크리스트를 만들어보는 편이 낫다. 그게 실제 체감 성능을 가장 빨리 바꾸는 경우가 많다.

나는 요즘 이 질문이 결국 같은 자리로 수렴한다고 느낀다. 좋은 모델보다, 덜 위험한 작업 시스템이 먼저다.

자주 묻는 질문 (FAQ)

Q1. 하네스 엔지니어링은 프롬프트 엔지니어링과 무엇이 다른가?

프롬프트 엔지니어링이 한 번의 출력 품질을 끌어올리는 데 더 가깝다면, 하네스 엔지니어링은 그 출력이 실제 운영에 들어가기까지의 작업 시스템을 설계하는 쪽에 가깝다. 문맥 주입, 권한 경계, 검증 루프, rollback, ownership까지 포함해서 다룬다는 점이 다르다.

Q2. 작은 팀도 이런 설계가 정말 필요한가?

오히려 작은 팀일수록 더 필요하다. 사람이 적으면 실수를 덮을 여유도 적고, 한 번 꼬였을 때 복구 비용이 훨씬 크게 온다. 그래서 누가 확인하고 어디서 멈출지, 실패했을 때 어떻게 되돌릴지를 먼저 정해두는 편이 훨씬 낫다.

Q3. 모델 업그레이드보다 먼저 손봐야 할 운영 체크리스트는 무엇인가?

내 기준으로는 다섯 가지다. measurement, ownership, permission boundary, verification loop, rollback path. 이 다섯 가지가 비어 있으면 더 좋은 모델을 붙여도 결과 편차와 운영 리스크만 커지는 경우가 많다.

Q4. DESIGN.md 하나만 잘 써도 체감 성능이 달라지나?

생각보다 많이 달라진다. 목표, 금지 범위, 성공 판정, 사람 확인 지점을 문서로 고정해두면 에이전트가 매번 의도를 다시 추론하는 비용이 줄고, 결국 작업 속도보다 편차가 먼저 줄어든다.

이런 글이 더 궁금하다면

매주 월요일, AI 자동화와 개발 이야기를 정리해서 보내고 있다. 블로그에 미처 못 쓴 삽질기와 운영 노하우도 포함된다.

비슷한 구조를 우리 팀이 직접 만들어드리기도 한다. 관심 있으면 상담 신청을 남겨주시면 된다.

KPI impact: published = 0

댓글