OpenAI가 Claude Code 안으로 들어왔다, Codex 플러그인이 던진 새 질문

도구 경쟁이 아니라 워크플로우 점유전이 시작됐다

OpenAI가 새 IDE를 만든 게 아니다. 더 흥미로운 건 경쟁사 도구인 Claude Code 안으로 자기 에이전트를 직접 들여보냈다는 점이다.

이 변화가 의미하는 건 단순한 플러그인 추가가 아니다. 이제 코딩 에이전트 경쟁은 “누가 더 똑똑하냐”보다 개발자가 이미 쓰는 세션과 습관을 누가 점유하느냐로 이동하고 있다.

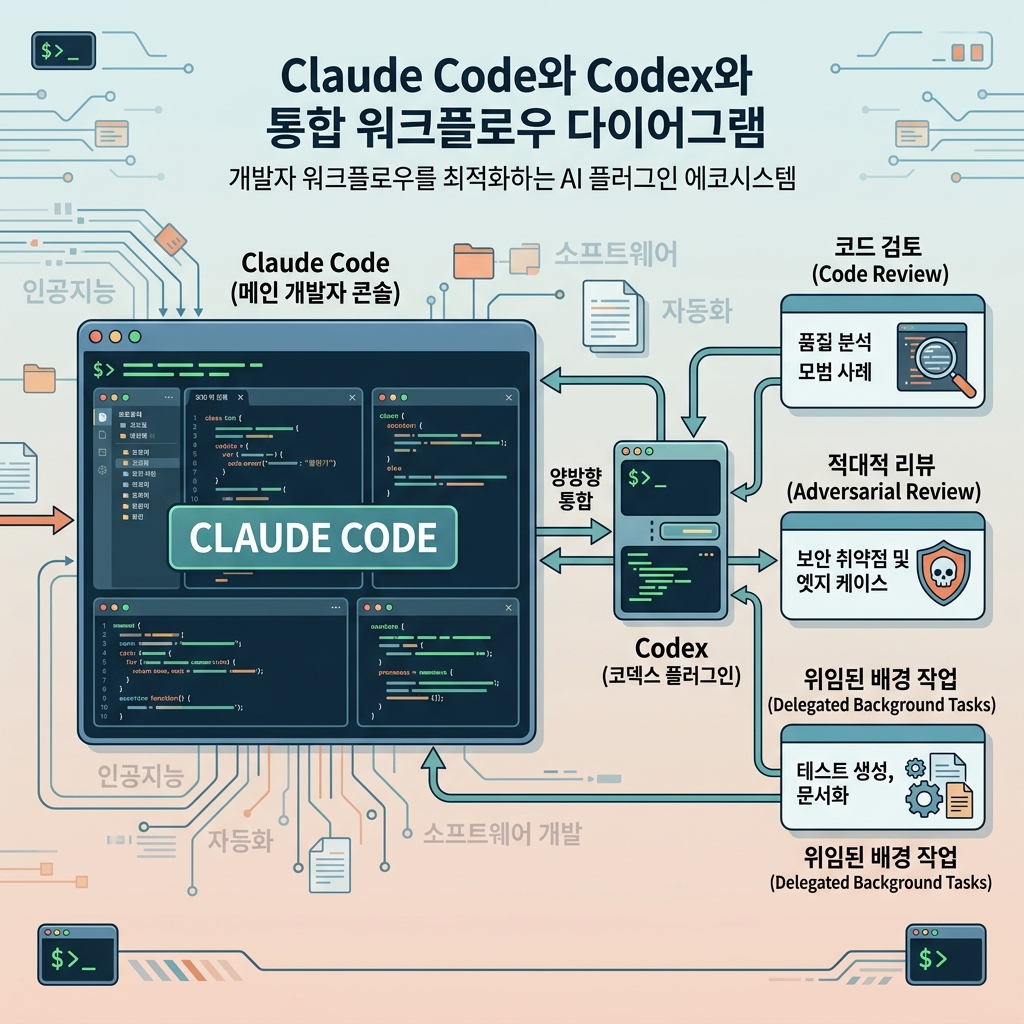

공식 README 기준으로 이 플러그인은 /codex:review, /codex:adversarial-review, /codex:rescue 같은 명령을 Claude Code 안에서 바로 호출하게 만든다. 설치 조건도 생각보다 낮다. ChatGPT 구독(Free 포함)이나 OpenAI API 키, 그리고 **Node.js 18.18+**만 있으면 시작할 수 있다. 진입 장벽을 확 낮춘 셈이다.

진짜 포인트는 “기존 세션 안에서 다른 에이전트를 부른다”는 점이다

지금까지 AI 코딩 도구 경쟁은 보통 IDE 대결처럼 보였다. Claude Code를 쓸지, Codex를 쓸지, Cursor를 쓸지 고르는 식이었다.

그런데 이번 플러그인은 그 프레임을 비튼다. 이미 Claude Code를 쓰는 사람이 툴을 갈아타지 않고, 같은 세션 안에서 Codex를 리뷰어나 백그라운드 실행기로 호출할 수 있기 때문이다. 즉, 제품 전환 비용보다 워크플로우 편입 비용이 더 중요해졌다.

이걸 한 줄로 요약하면 이렇다.

이제 경쟁은 “내 도구로 오라”가 아니라 “네가 있는 곳에 내가 들어가겠다”가 됐다.

이 구조가 중요한 이유는 명확하다.

- 개발자는 새 툴의 UX를 다시 익히지 않아도 된다

- 팀은 기존 Claude Code 사용 습관을 유지한 채 검증 레이어를 추가할 수 있다

- 서로 다른 에이전트를 역할별로 분리해 운영할 수 있다

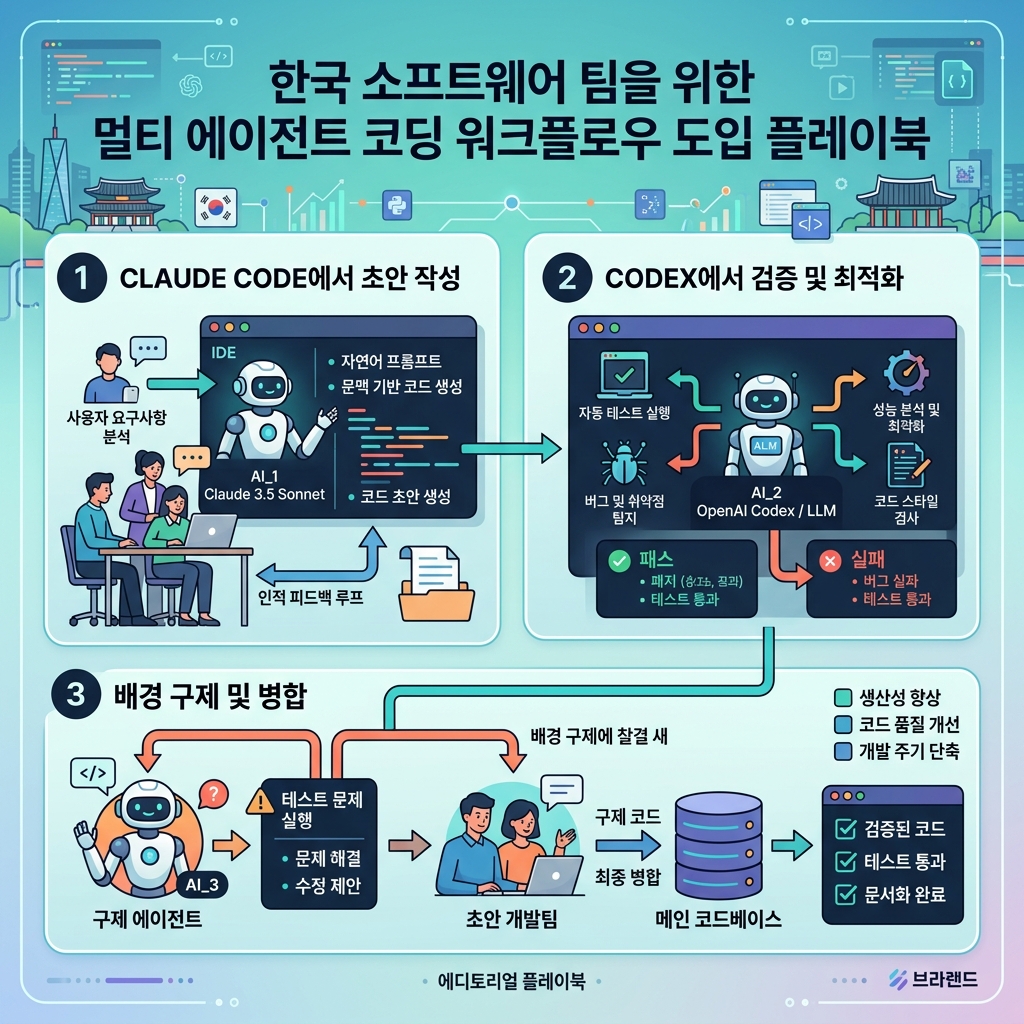

특히 한국 개발팀에서 자주 나오는 흐름, 즉 빠르게 초안을 만들고 별도 검토로 안전장치를 거는 방식과 꽤 잘 맞는다.

세 가지 명령이 만든 건 단순 기능이 아니라 역할 분리다

README에 적힌 핵심 명령은 세 갈래다.

| 명령 | 역할 | 실무에서 의미하는 것 |

|---|---|---|

/codex:review | 읽기 전용 일반 리뷰 | 현재 변경분을 빠르게 한번 더 검토 |

/codex:adversarial-review | 공격적으로 의심하는 리뷰 | 설계, 롤백, race condition 같은 리스크 압박 점검 |

/codex:rescue | 백그라운드 작업 위임 | 조사, 수정 시도, 후속 작업을 별도 실행 |

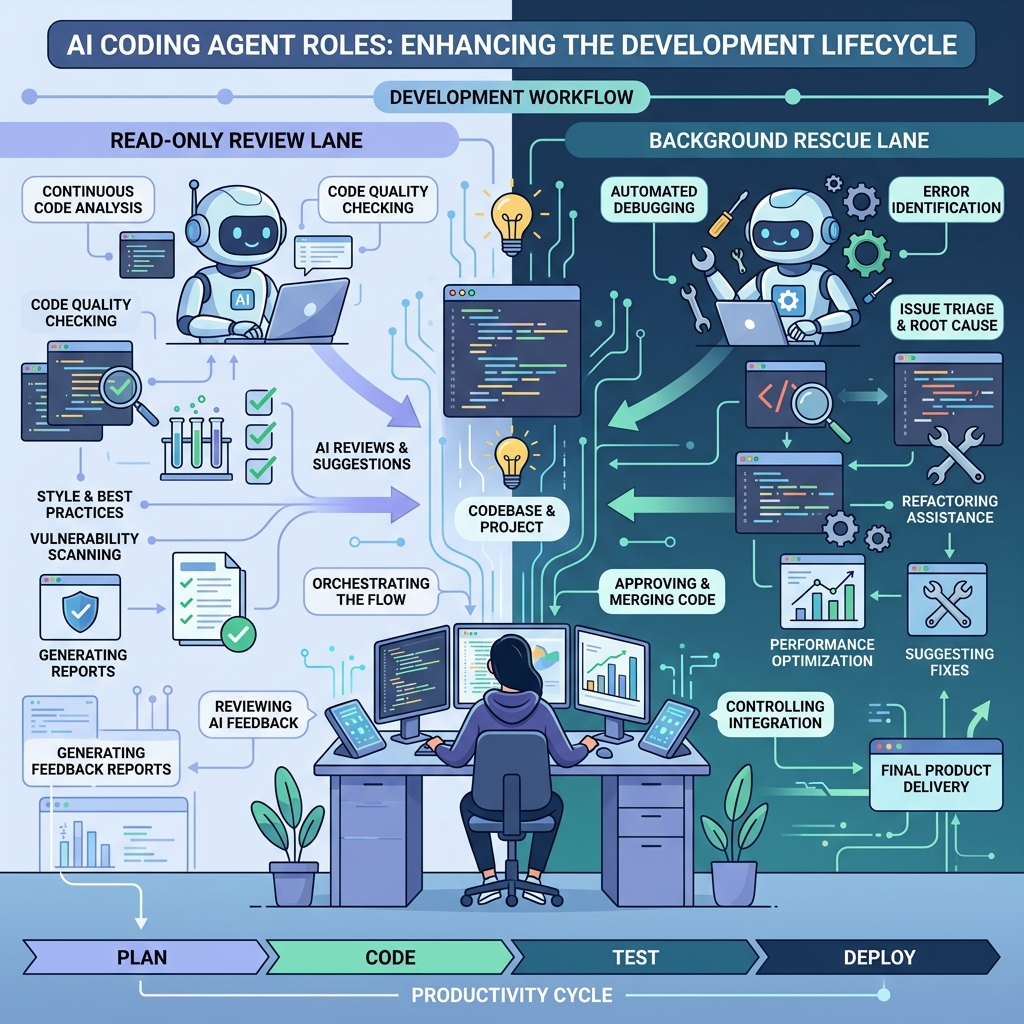

이 분리가 꽤 영리하다. 많은 팀이 실제로 원하는 건 “AI 하나가 다 해주는 것”보다 작성자와 검토자, 실행자를 나눠서 쓰는 것이기 때문이다.

예를 들면 이런 흐름이 바로 가능해진다.

/codex:review --background/codex:adversarial-review --background look for rollback and race condition risks/codex:rescue investigate why the flaky integration test started failing/codex:status/codex:result이건 단순히 명령이 많아졌다는 얘기가 아니다. 한 세션 안에서 다음 세 단계를 나눌 수 있다는 뜻이다.

- Claude Code로 초안 작성

- Codex로 읽기 전용 검증

- 필요하면 Codex에 백그라운드 조사나 수정 위임

여기서 특히 눈에 띄는 건 adversarial-review다. 보통 AI 리뷰는 친절하게 맞장구치기 쉽다. 그런데 이 모드는 아예 설계 자체를 의심하는 방향으로 이름이 붙어 있다. 이건 OpenAI가 이제 단순 생성보다 검증과 반론 생산도 코딩 워크플로우의 핵심 가치로 본다는 신호에 가깝다.

이 변화는 모델 성능 경쟁보다 더 현실적이다

솔직히 한국 개발자 입장에서 모델 벤치마크 비교는 이제 조금 피로하다. 점수표는 넘치는데, 막상 팀에 넣어보면 문제는 늘 비슷하다.

- 누가 결과를 검토할 것인가

- 장시간 작업은 어디서 돌릴 것인가

- 실패한 작업을 어떻게 다시 이어받을 것인가

- 비용과 사용량은 어떻게 관리할 것인가

이번 플러그인은 이 질문에 꽤 현실적인 답을 던진다. README를 보면 이 플러그인은 별도 독립 런타임이 아니라 로컬 Codex CLI와 같은 인증 상태, 같은 설정, 같은 저장소 환경을 그대로 쓴다. 즉, 기존 Codex 사용자는 설정을 다시 설계할 필요가 적다.

또 하나 중요한 건 도입 장벽이다. 새 계정을 따로 만드는 구조가 아니라 ChatGPT 구독이나 API 키로 바로 연결되고, 설치도 Claude Code의 플러그인 흐름에 맞춰 붙는다. 이건 조직 입장에서 “작게 시작해 보기”가 쉽다는 뜻이다.

반대로 리스크도 있다. README는 review gate를 켰을 때 Claude와 Codex가 길게 루프를 돌며 사용량을 빠르게 소모할 수 있다고 경고한다. 즉, 이 도구의 핵심은 마법 같은 자동화가 아니라 누가 언제 어디까지 검토권을 가지는지 설계하는 능력이다.

정리하면, 이번 발표의 본질은 새 모델이 아니다. 서로 다른 에이전트를 같은 작업대 안에서 조합하는 운영 패턴이 공식화됐다는 데 있다.

한국 개발팀은 이렇게 받아들이는 게 가장 실용적이다

내가 보기엔 이 플러그인을 “OpenAI가 Claude Code를 이겼다” 혹은 “Claude Code가 더 개방적이다” 같은 승패 프레임으로 읽으면 핵심을 놓친다.

더 중요한 질문은 이거다.

우리 팀은 AI를 단일 비서처럼 쓸 것인가, 아니면 역할이 나뉜 팀처럼 쓸 것인가?

한국 개발팀 기준으로는 아래처럼 해석하는 게 실전적이다.

1. 메인 작업은 익숙한 도구에서 유지

이미 Claude Code를 쓰고 있다면 굳이 팀 전체를 갈아태울 이유는 없다. 작성과 탐색은 익숙한 세션에서 계속하는 편이 교육 비용이 낮다.

2. 검증은 다른 에이전트로 분리

기능 추가나 리팩터링 뒤에는 /codex:review 또는 /codex:adversarial-review를 붙여서 관점을 일부러 분리하는 게 좋다. 같은 모델만 오래 쓰면 놓치는 패턴이 생기기 쉽다.

3. 오래 걸리는 조사와 복구는 백그라운드 위임

테스트 플래키 원인 추적, 작은 회귀 수정, 로그 기반 조사처럼 사람 집중력을 갉아먹는 일은 /codex:rescue와 잘 맞는다.

결국 이번 플러그인이 던진 질문은 꽤 크다. 앞으로 코딩 에이전트 시장은 모델 하나의 우열보다 워크플로우 안에서 어떤 자리를 차지하느냐로 갈릴 가능성이 높다.

그리고 그 변화는 생각보다 빨리 온다. 개발자는 이미 여러 에이전트를 함께 쓰기 시작했고, 벤더들도 이제 그 현실을 인정하기 시작했다. 이번 Codex 플러그인은 그걸 보여주는 꽤 상징적인 신호다.

한국 개발자에게 실질적인 의미도 명확하다. 앞으로는 “무슨 도구를 쓸까”보다 **“어떤 역할 분담으로 묶어 쓸까”**가 더 중요한 의사결정이 된다. 이 기준으로 보면, 이번 발표는 작은 플러그인 출시가 아니라 멀티에이전트 개발 문화의 초입에 가깝다.