Gemma 4가 Apache 2.0으로 돌아선 이유, 이제 로컬 AI의 판이 바뀐다

성능보다 라이선스가 더 중요한 이유

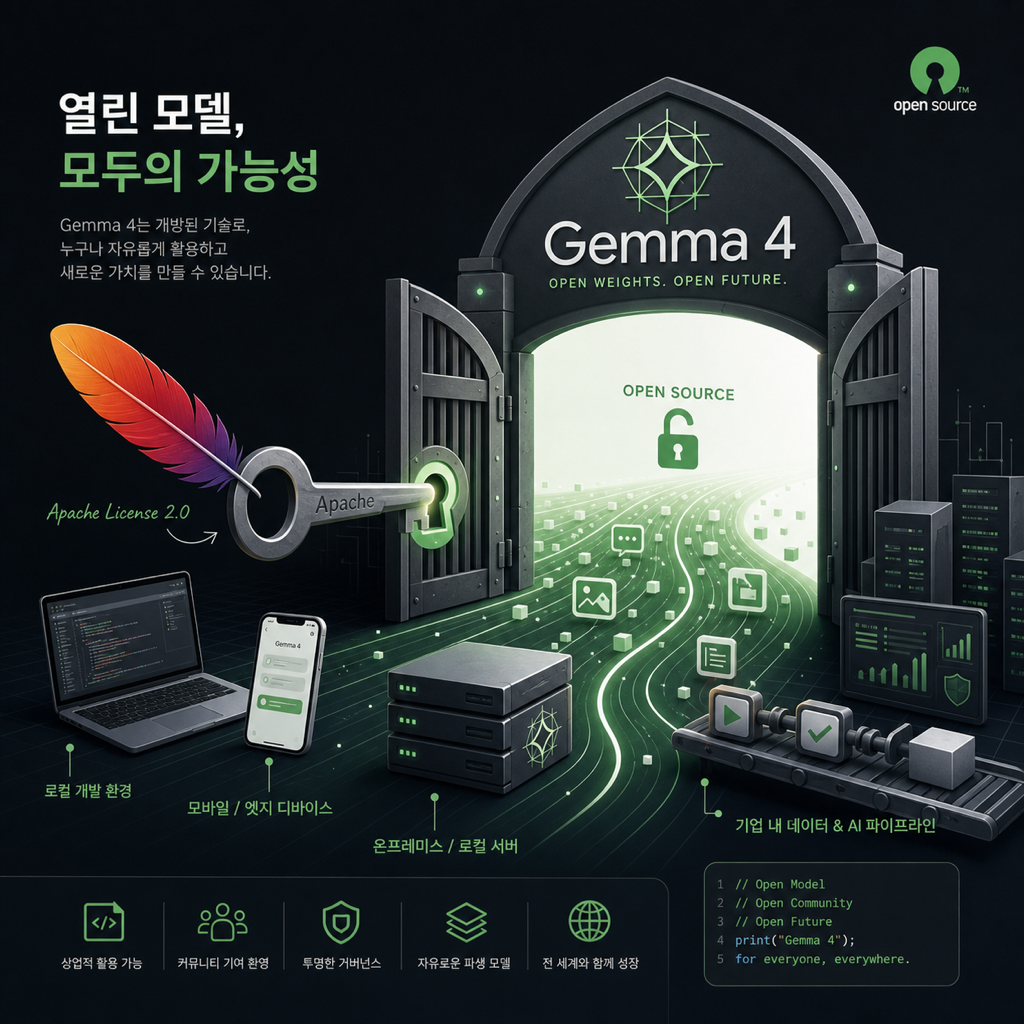

Gemma 4 뉴스에서 가장 중요한 건 모델 점수가 아니다. 진짜 뉴스는 Apache 2.0이다.

많은 사람들이 새 모델이 나오면 먼저 벤치마크 표를 본다. 몇 점이 올랐는지, 누구를 이겼는지, 컨텍스트가 얼마나 길어졌는지 같은 것들 말이다. 그런데 Gemma 4는 조금 다르게 봐야 한다. 이번 발표의 핵심은 “Google이 또 모델 하나 냈다”가 아니라, Google이 개발자 생태계와의 관계를 다시 설계하기 시작했다는 데 있다.

그동안 Gemma 계열은 오픈 웨이트에 가깝게 보였지만, 실제 현업에서 중요한 질문은 늘 따로 있었다. “이거 진짜 서비스에 넣어도 되나?”, “법무 검토를 얼마나 해야 하지?”, “고객사 납품형 기능에 붙여도 문제 없나?” 같은 질문이다. 기술적으로 돌릴 수 있는 것과, 조직이 안심하고 채택할 수 있는 것은 전혀 다른 문제다.

Gemma 4의 Apache 2.0 전환은 바로 그 간극을 줄인다. 그래서 이 변화는 모델 발표이면서 동시에 로컬 AI와 오픈 모델 시장의 판을 바꾸는 신호다.

왜 이번엔 성능보다 라이선스가 더 중요할까

보통 모델 출시 뉴스는 성능 중심으로 소비된다. 하지만 실제 실무에서는 성능보다 먼저 사용 가능성이 검토된다. 특히 회사 안으로 들어가는 순간 더 그렇다.

예를 들어 팀에서 로컬 LLM을 검토할 때는 이런 질문이 같이 나온다.

- 상업 이용이 확실하게 허용되는가

- 사내 폐쇄망에 올려도 되는가

- 재배포나 파인튜닝, 내장형 제품 적용이 가능한가

- 고객사 보안 검토나 법무 검토에서 막히지 않는가

이전에는 Gemma가 기술적으로 흥미로워도, 라이선스가 완전히 편한 축은 아니었다. “오픈처럼 보이지만 완전히 자유롭다고 말하기는 애매한” 상태는 실무 도입에서 꽤 큰 마찰을 만든다. 엔지니어는 괜찮다고 해도, 법무나 보안팀이 애매하다고 느끼면 그 순간 검토가 멈춘다.

Apache 2.0은 이런 불확실성을 크게 줄여준다. 물론 회사마다 최종 검토는 따로 하겠지만, 적어도 개발자 입장에서는 판단의 기준이 훨씬 선명해진다. 그래서 이번 뉴스의 핵심은 “Gemma 4가 얼마나 좋아졌나”보다 Gemma 4가 이제 얼마나 쓰기 쉬운 모델이 됐나에 가깝다.

Google은 왜 지금 더 열렸을까

이건 단순히 선의의 결정으로만 보기 어렵다. 시장 압박이 분명히 있었다.

DeepSeek, Qwen 같은 모델들이 개발자 생태계를 빠르게 흡수하면서, 오픈 모델 시장의 기준이 달라졌다. 이제는 “성능이 괜찮다”만으로는 부족하다. 개발자들은 다음까지 같이 본다.

- 라이선스가 깔끔한가

- 로컬에서 잘 도는가

- 생태계 툴링이 붙는가

- 기업이 실제로 채택할 수 있는가

이 기준에서 Google은 다소 애매한 자리에 있었다. 기술력은 강하지만, 오픈 생태계에서 개발자 친화성은 경쟁사보다 덜 공격적으로 보일 수 있었다. 그런 상황에서 Gemma 4를 Apache 2.0으로 낸 건 사실상 이런 선언에 가깝다.

“우리도 이제 모델 품질만이 아니라 채택 가능성으로 경쟁하겠다.”

이건 꽤 중요한 변화다. 오픈 모델 시장이 이제 연구용 실험을 넘어서, 실제 배포와 운영의 시장으로 이동하고 있다는 뜻이기 때문이다.

로컬 AI가 다시 현실적인 선택지가 된 이유

Gemma 4가 더 흥미로운 건 라이선스와 로컬 실행성이 같이 붙었다는 점이다.

요즘 많은 팀이 클라우드 API만으로는 한계를 느낀다. 이유는 단순하다.

- 비용이 예측하기 어렵다

- 민감한 데이터가 외부로 나간다

- latency와 네트워크 의존성이 있다

- 고객사 요구사항 때문에 외부 API 사용이 막힌다

이때 로컬 모델은 단순한 “비용 절감 대안”이 아니다. 오히려 통제권 회복 수단에 가깝다. 모델이 로컬이나 사내 환경에서 돌면, 데이터 경계가 분명해지고, 운영 정책을 더 직접 설계할 수 있다.

예를 들어 이런 시나리오가 더 현실적이 된다.

- 사내 문서 검색 에이전트

- 고객사 전용 폐쇄망 요약/분류 시스템

- 온디바이스 보조 기능

- 코드 보조, 문서 처리, 검토 자동화

- 오프라인 또는 저지연 환경용 AI 기능

Apache 2.0 전환은 이걸 “재밌는 실험”에서 “진짜 검토 가능한 옵션”으로 바꾼다.

에이전트 시대에 왜 Gemma 4가 더 잘 맞아 보이나

요즘 모델 경쟁은 단순 챗봇 품질보다 워크플로우 적합성으로 이동하고 있다. 특히 에이전트 쪽에선 더 그렇다.

에이전트가 실무에 들어가려면 그냥 말만 잘하는 걸로는 부족하다. 최소한 아래가 필요하다.

- 구조화된 출력

- 함수 호출 친화성

- 반복 실행 안정성

- 짧은 추론 루프에서의 효율

- 로컬/온프렘 배포 가능성

Gemma 4는 바로 이 문맥에서 의미가 커진다. 모델 하나가 끝판왕이라서가 아니라, 에이전트 워크플로우에 붙이기 좋은 성격을 갖기 시작했기 때문이다.

예를 들어 로컬 에이전트에서 구조화된 JSON 출력을 강하게 요구하는 경우를 생각해보자.

response_schema = { "task": "summarize_customer_ticket", "required": ["priority", "category", "next_action"], "properties": { "priority": {"type": "string"}, "category": {"type": "string"}, "next_action": {"type": "string"} }}

prompt = f"""아래 티켓을 읽고 반드시 JSON으로만 답해.Schema: {response_schema}"""이런 식의 structured output은 실무 자동화에서 점점 기본값이 되고 있다. 여기에 함수 호출이나 도구 친화성이 붙으면, 모델은 더 이상 단순 생성기가 아니라 워크플로우의 실행 단위가 된다.

그러니까 Gemma 4의 가치는 “오픈 모델인데 성능이 괜찮다” 수준이 아니라, 오픈 라이선스 + 로컬 배포 + 에이전트 적합성의 조합에 있다.

한국 개발자에게 중요한 건 비용보다 통제권이다

한국 커뮤니티에서는 늘 비용 이야기가 먼저 나오지만, 실제 도입 단계에서는 통제권이 더 큰 문제가 되는 경우가 많다.

특히 다음 같은 팀은 그렇다.

- 고객사 납품형 SI/솔루션 팀

- 금융, 헬스케어, 공공처럼 데이터 민감도가 높은 조직

- 해외 API 의존을 줄이고 싶은 팀

- 모바일, 온디바이스, 엣지 환경을 고려하는 팀

이 팀들에게 중요한 건 “조금 더 싸냐”가 아니다. 더 중요한 건 아래다.

- 이 모델을 사내에 넣어도 되는가

- 고객 데이터가 밖으로 나가지 않게 할 수 있는가

- 나중에 배포 구조를 내가 통제할 수 있는가

- 라이선스 검토에 불필요한 리스크가 없는가

이 관점에서 보면 Gemma 4의 Apache 2.0 전환은 단순한 오픈소스 미담이 아니라, 채택 허들을 실제로 낮춘 사건이다.

예를 들어 로컬 추론 워크플로우를 이렇게 가져갈 수 있다.

# 예시: 사내 폐쇄망 서버에서 로컬 모델 서빙serve-model --model gemma-4 \ --port 8080 \ --structured-output \ --tool-calling enabled

# 내부 워크플로우에서만 호출curl http://internal-llm:8080/generate \ -H "Content-Type: application/json" \ -d '{"prompt":"내부 문서를 요약하고 다음 액션을 JSON으로 정리해줘"}'이런 구조는 단순히 API 요금을 줄이는 게 아니라, 데이터 흐름과 실행 경계를 스스로 관리하게 해준다. 요즘처럼 trust boundary가 중요해지는 흐름에서 이건 꽤 큰 장점이다.

이제 판이 어떻게 바뀔까

Gemma 4가 Apache 2.0으로 돌아섰다는 건 Google 하나의 변화가 아니다. 이건 시장 전체에 신호를 준다.

앞으로 개발자들은 모델을 볼 때 이렇게 비교할 가능성이 더 커진다.

- 성능은 어느 정도인가

- 로컬에서 얼마나 현실적으로 도는가

- 라이선스가 실제 서비스 적용에 안전한가

- 에이전트 워크플로우에 붙이기 쉬운가

- 장기적으로 통제권을 내가 가질 수 있는가

즉, 이제 판은 “누가 더 좋은 모델인가”에서 끝나지 않는다. 누가 더 배포 가능하고, 더 설명 가능하며, 더 통제 가능한가까지 같이 봐야 한다.

이 점에서 Gemma 4의 Apache 2.0 전환은 꽤 상징적이다. Google도 결국 개발자 생태계 경쟁에서 라이선스와 운영 현실을 더 이상 무시할 수 없다는 뜻이기 때문이다.

결론: 이제 로컬 AI는 기술 선택이 아니라 전략 선택이다

Gemma 4의 진짜 뉴스는 성능이 아니라 라이선스다. 그리고 그 라이선스 변화는 로컬 AI, 온프렘 AI, 에이전트 워크플로우, 사내 배포 전략 전체를 다시 보게 만든다.

나는 이걸 단순한 모델 출시로 보지 않는다. 이건 오픈 모델 시장이 한 단계 더 현실로 내려온 사건이다. “재밌으니까 써보자”가 아니라 **“이제 실제 제품에 넣어도 되나”**를 이야기할 수 있게 됐다는 점에서 그렇다.

앞으로 한국 개발자에게 더 중요한 질문도 비슷해질 거다.

- 이 모델이 얼마나 똑똑한가?

- 보다

- 이 모델을 내가 얼마나 안심하고 서비스에 넣을 수 있는가?

Gemma 4는 그 질문에 대해, 이전보다 훨씬 강한 답을 주기 시작했다.

이제 로컬 AI의 판은 정말 바뀌고 있다.